Компания IBM запускает инструмент, который будет анализировать, как и почему алгоритмы ИИ (искусственного интеллекта) принимают решения и все это в режиме реального времени.

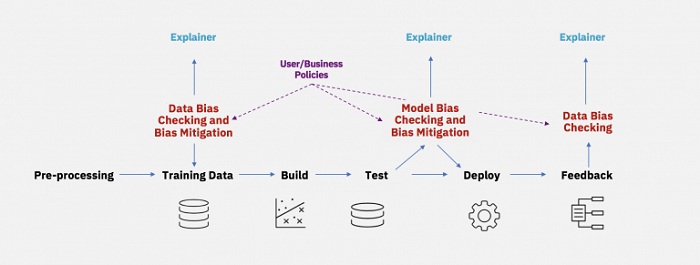

«Мы рады анонсировать ИИ Fairness 360 (AIF360), комплексный инструментарий метрик с открытым исходным кодом для проверки нежелательного смещения в наборах данных и моделях машинного обучения, а также современные алгоритмы для смягчения такого смещения. Мы приглашаем вас использовать его и вносить в него изменения, чтобы помочь повысить доверие к ИИ и сделать мир более справедливым для всех».

Сейчас растет беспокойство, что алгоритмы, используемые как техническими гигантами, так и более мелкими предприятиями, не всегда точны в процессе принятия решений. К примеру, недавно система распознавания не смогла идентифицировать лицо темнокожего человека. А поскольку принятие решений все чаще происходит в автоматическом режиме в таких направлениях, как полицейская деятельность, страхование или получение информация о том, что люди просматривают в Интернете, последствия при неправильно принятом решении могут быть плачевными.

Сейчас растет беспокойство, что алгоритмы, используемые как техническими гигантами, так и более мелкими предприятиями, не всегда точны в процессе принятия решений. К примеру, недавно система распознавания не смогла идентифицировать лицо темнокожего человека. А поскольку принятие решений все чаще происходит в автоматическом режиме в таких направлениях, как полицейская деятельность, страхование или получение информация о том, что люди просматривают в Интернете, последствия при неправильно принятом решении могут быть плачевными.

Программное обеспечение для облачных вычислений IBM будет с открытым исходным кодом и будет работать с различными часто используемыми структурами для построения алгоритмов.

Пользователи смогут увидеть при помощи визуальной панели, каким образом их алгоритмы принимают решения и какие факторы используются при составлении окончательных рекомендаций.

«Мы даем новые возможности в виде прозрачности и контроля предприятиям, которые используют ИИ и сталкиваются с большим потенциальным риском от любого ошибочного принятого решения», — сказал Дэвид Кенни (David Kenny), старший вице-президент Cognitive Solutions (департамент IBM Research).

Этой проблемой занимается не только компания IBM. К примеру, на прошлой неделе Google запустил инструмент «что-если», также разработанный, чтобы помочь пользователям понять, как работают их модели машинного обучения. Однако инструмент Google не работает в режиме реального времени (в отличие от Fairness 360) — данные могут быть использованы для построения общей картины только через время.

В мае в Microsoft заявили, что они работают над инструментарием обнаружения «смещения» в алгоритмах, а в Facebook заявили, что уже тестируют инструмент, помогающий определить, является ли алгоритм предвзятым в принятии решений.

Растет дискуссия вокруг искусственного интеллекта и этики. В 2015 году Google уже приносил свои извинения за то, что их алгоритм для фотографий Google Photos идентифицировал афроамериканцев как горилл.

Источник: bbc